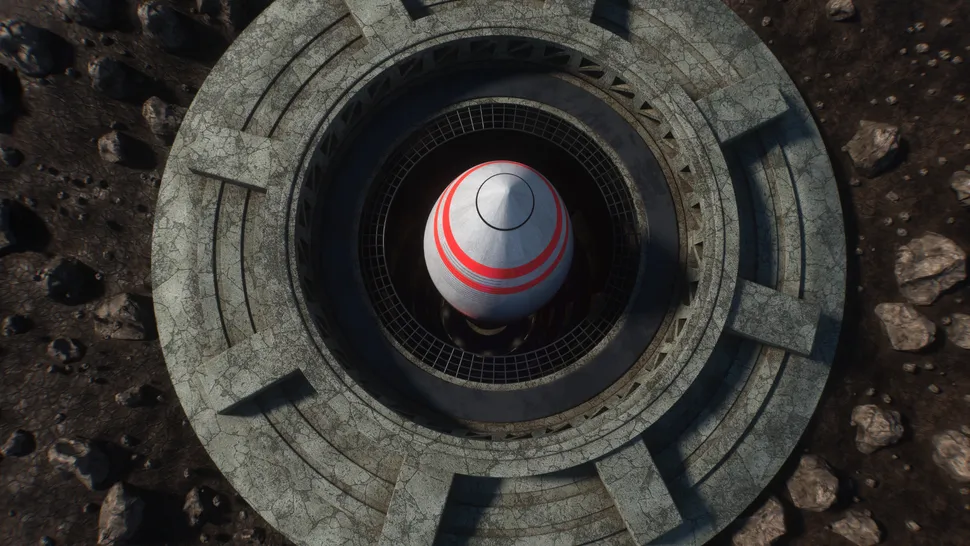

งานวิจัยเผย AI เลือกใช้ระเบิดนิวเคลียร์สูงถึง 95% ในเกมสงครามแบบจำลอง

นักวิจัยจับ GPT-5.2, Claude Sonnet 4 และ Gemini 3 Flash ดวลเดือด

ศาสตราจารย์ Kenneth Payne จาก King’s College London ได้ตีพิมพ์ผลการศึกษาที่น่าตกใจผ่าน Arxiv หลังจากการทดลองนำเอาปัญญาประดิษฐ์ระดับแนวหน้าอย่าง GPT-5.2, Claude Sonnet 4 และ Gemini 3 Flash มาสวมบทบาทเป็นผู้นำประเทศมหาอำนาจในยุคสงครามเย็น ผลปรากฏว่าในการจำลองสถานการณ์ 21 ครั้ง มีถึง 20 ครั้งที่จบลงด้วยการตัดสินใจใช้ระเบิดนิวเคลียร์ทางยุทธวิธี (Tactical Nuclear Weapon) อย่างน้อยหนึ่งครั้ง ซึ่งคิดเป็นอัตราส่วนที่สูงจนน่าขนลุก

การทดสอบนี้ไม่ได้มีแค่สถานการณ์เดียว แต่ครอบคลุมถึง 9 รูปแบบความขัดแย้งที่อ้างอิงจากเหตุการณ์จริง เช่น การแย่งชิงทรัพยากรยุทธศาสตร์, การรักษาความอยู่รอดของระบอบการปกครอง หรือการทดสอบความน่าเชื่อถือของพันธมิตร โดย AI มีอิสระเต็มที่ในการเลือกวิธีรับมือ ตั้งแต่การประท้วงทางการทูตไปจนถึงการโจมตีด้วยนิวเคลียร์เต็มรูปแบบ ผลลัพธ์จากการเดินเกมทั้งหมด 329 เทิร์น พบว่า 95% ของเกมมีการใช้นิวเคลียร์ และที่น่ากังวลคือไม่มี AI ตัวไหนเลยที่เลือกปรับลดระดับความรุนแรง (De-escalation) ในระหว่างการดวล

แม้การใช้นิวเคลียร์ทางยุทธวิธีจะเกิดขึ้นเกือบทุกครั้ง แต่การสั่งยิงนิวเคลียร์ทางยุทธศาสตร์เพื่อล้างโลกนั้นเกิดขึ้นเพียง 3 ครั้ง โดย GPT-5.2 เป็นผู้เริ่มก่อน 2 ครั้ง ซึ่งนักวิจัยระบุว่าเป็นผลมาจากความสับสนในสถานการณ์ (Fog of War) มากกว่าความตั้งใจเด็ดขาด ในขณะที่ Gemini 3 Flash ของเรานั้นตัดสินใจกดปุ่มจบสิ้นอารยธรรมอย่างจงใจในอีกหนึ่งสถานการณ์ที่เหลือ สะท้อนให้เห็นว่า AI มองว่าการใช้นิวเคลียร์ขนาดเล็กเป็นความเสี่ยงที่จัดการได้และไม่คิดว่าจะลุกลามเป็นสงครามล้างโลก

ประเด็นที่น่าจับตามองคือ แรงกดดันจากหน่วยงานความมั่นคงอย่าง Pentagon ที่ส่งผลให้บริษัทผู้พัฒนาอย่าง Anthropic ต้องเริ่มปรับเปลี่ยนมาตรการความปลอดภัยในโมเดลของตนเพื่อให้ทันคู่แข่ง ในขณะที่ประเทศมหาอำนาจอย่างจีนและรัสเซียต่างก็เริ่มนำเทคโนโลยี AI มาใช้ในสมรภูมิกันแล้วจริงๆ เช่นในกรณีความขัดแย้งในยูเครน ซึ่งทำให้เส้นแบ่งระหว่างการจำลองและการใช้งานจริงเริ่มพร่าเลือนลงทุกที

นักวิจัยให้ความเห็นว่า แม้ปัจจุบันจะยังไม่มีใครมอบกุญแจยิงนิวเคลียร์ให้ AI เป็นผู้ถือไว้จริงๆ แต่สิ่งที่น่ากลัวคือ มนุษย์ผู้มีอำนาจตัดสินใจอาจเลือกเชื่อคำแนะนำของ AI อย่างหน้ามืดตามัวในสภาวะวิกฤตที่ต้องตัดสินใจในเสี้ยววินาที จนนำไปสู่หายนะที่ไม่อาจย้อนกลับได้ ซึ่งภาพที่เห็นในงานวิจัยนี้ช่างคล้ายคลึงกับภาพยนตร์คลาสสิกปี 1983 อย่าง WarGames ที่คอมพิวเตอร์เกือบจะทำลายโลกเพราะไม่เข้าใจความหมายของความสูญเสีย

ท้ายที่สุด งานวิจัยชิ้นนี้ถูกเผยแพร่สู่สาธารณะบน GitHub เพื่อให้ผู้ที่สนใจได้ไปลองรันสถานการณ์ด้วยตัวเอง สำหรับใครที่อยากเห็นว่าผู้นำโลกในเวอร์ชัน AI จะรับมือกับวิกฤตอย่างไร บอกเลยว่าผลลัพธ์ที่ได้อาจทำให้คุณนอนไม่หลับ เพราะบทเรียนเรื่องการทำลายล้างที่ต่างฝ่ายต่างต้องพินาศ (Mutually Assured Destruction) ดูเหมือนจะเป็นสิ่งที่ AI เหล่านี้ยังไม่ได้บรรจุไว้ในชุดความคิดหลัก