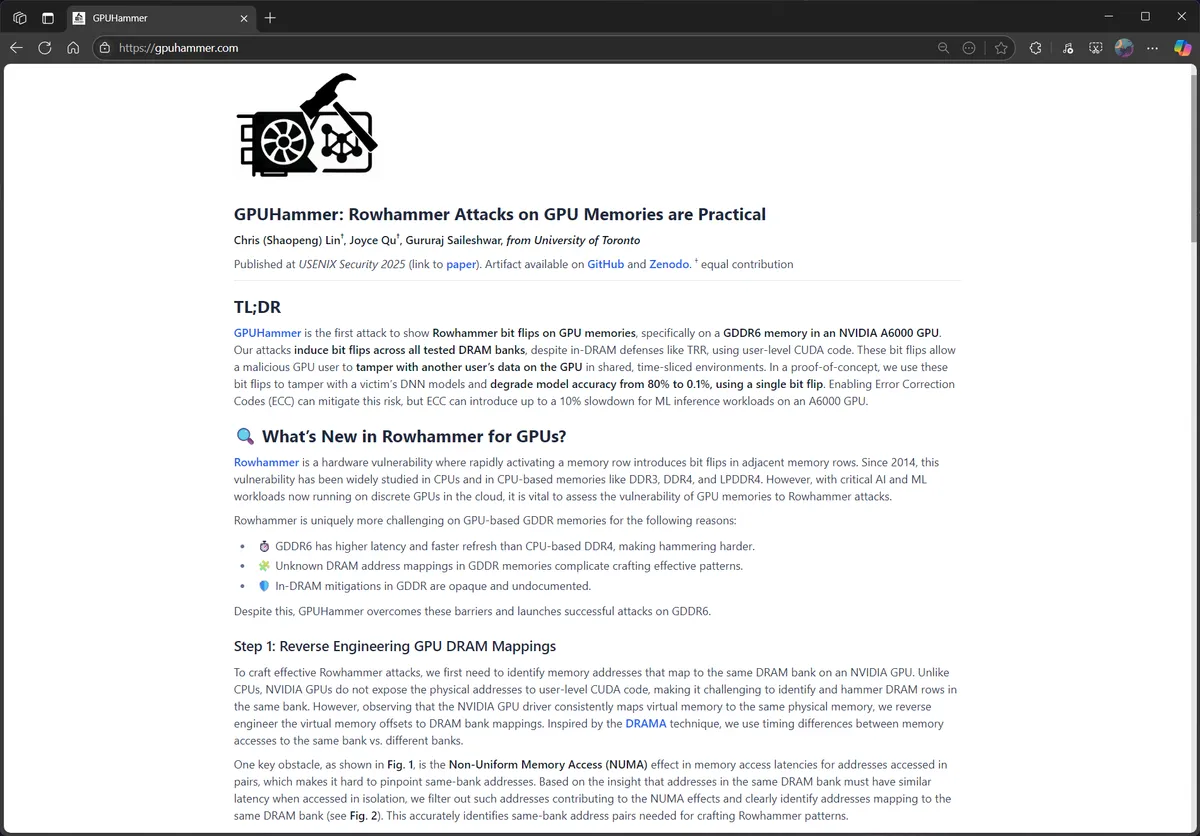

กลุ่มนักวิจัยจากมหาวิทยาลัยโทรอนโตเปิดโปงการโจมตีใหม่ที่เรียกว่า GPUHammer ซึ่งสามารถแปรเปลี่ยนข้อมูลในหน่วยความจำของ GPU โดยตรง และทำให้โมเดลปัญญาประดิษฐ์ทำงานผิดพลาดได้โดยไม่ต้องแตะโค้ดหรือข้อมูลนำเข้าเลย แม้ว่า NVIDIA จะออกมาแนะนำแนวทางป้องกันแล้ว แต่ถ้าใช้ GPU ที่ใช้หน่วยความจำ GDDR6 การรู้เรื่องนี้ถือว่าสำคัญมาก

จากการทดสอบจริงบน NVIDIA RTX A6000 นักวิจัยสามารถลดความแม่นยำของโมเดล AI จาก 80% เหลือต่ำกว่า 1% เพียงแค่พลิกบิตหนึ่งตัวในหน่วยความจำ เทคนิคนี้อาศัยการโจมตีแบบ Rowhammer ที่เคยเห็นใน RAM มาสู่ VRAM ของ GPU เป็นครั้งแรก ซึ่งเกิดจากการเขียน/อ่านแถวข้อมูลซ้ำ ๆ จนสร้างการรบกวนทางไฟฟ้าและเปลี่ยนค่าบิตในแถวใกล้เคียง

GPUHammer ไม่ใช่แค่ทฤษฎี แต่เป็นความเสี่ยงจริง โดยเฉพาะในสภาพแวดล้อมที่หลายผู้ใช้แชร์ GPU เครื่องเดียวกัน เช่น ระบบคลาวด์เกมมิ่ง, เซิร์ฟเวอร์ฝึก AI หรือ VDI เพราะผู้โจมตีไม่จำเป็นต้องเจาะระบบ แค่ใช้ GPU ร่วมกับเหยื่อก็อาจแทรกแซงการทำงานได้แล้ว

แม้จะทดลองบน RTX A6000 แต่ NVIDIA ระบุว่าช่องโหว่นี้กระทบ GPU หลายรุ่นในสถาปัตยกรรม Ampere, Ada, Hopper และ Turing โดยเฉพาะรุ่นที่ใช้ในงานวิชาการและเซิร์ฟเวอร์ อย่างไรก็ตาม GPU รุ่นใหม่เช่น RTX 5090 และ H100 มี ECC (Error Correction Code) ในตัว ซึ่งช่วยตรวจจับและแก้ไขข้อผิดพลาดอัตโนมัติ

สำหรับผู้ใช้งานทั่วไป ECC คือคำตอบของปัญหานี้ หาก GPU รองรับควรเปิดใช้งาน เพราะจะช่วยปกป้องข้อมูลในหน่วยความจำจากรบกวนทางกายภาพ แม้จะมีผลต่อประสิทธิภาพเล็กน้อย เช่น VRAM ลดลง 6-6.5% และความเร็วในการประมวลผลลดลงประมาณ 10%

การโจมตีแบบนี้ไม่ได้ทำให้เครื่องดับหรือโปรแกรมเด้งเท่านั้น แต่เปลี่ยนพื้นฐานของ AI โดยตรง ซึ่งอาจนำไปสู่การตัดสินใจผิดพลาดในวงการแพทย์ การเงิน หรือรถยนต์อัตโนมัติ แม้ผู้ใช้ทั่วไปจะเสี่ยงน้อย แต่กรณีศึกษานี้สะท้อนให้เห็นว่าเมื่อ GPU กลายเป็นสมองกลของโลกดิจิทัล ความปลอดภัยของหน่วยความจำก็ไม่ใช่เรื่องเล็กอีกต่อไป